Notes for: A Simple Semi-Supervised Learning Framework for Object Detection

概述

STAC:

-

半监督学习(SSL)

-

从未标记的图像中部署高度自信的本地化对象伪标签

-

通过增强数据来增强一致性,从而更新模型

SSL简介

-

提供了在没有大规模注释数据时使用未标记数据来提高模型性能的方法

- 首先为未标记的数据提供人工标签。

- 然后使用语义保留的方法用其他的标签来对这个标签进行预测和更新。

-

数据增强

- 提高神经网络的鲁棒性

- 对SSL的图像分类功能非常强大!

-

在对象检测问题中也需要这种方法,因为标记成本比较昂贵

方法流程

-

对数据集进行阶段性培训

- 使用所有可用的标记数据训练教师模型

- 使用标记和未标记的数据训练STAC

- 使用高阈值来控制伪标签的质量

-

Train a teacher model on available labeled images.

-

Generate pseudo labels of unlabeled images (i.e., bounding boxes and their class labels) using the trained teacher model.

-

Apply strong data augmentations to unlabeled images, and augment pseudo labels (i.e. bounding boxes) correspondingly when global geometric transformations are applied.

-

Compute unsupervised loss and supervised loss to train a detector.

-

训练教师模型

-

基于FASTER RCNN

-

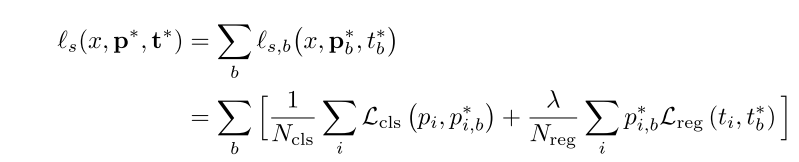

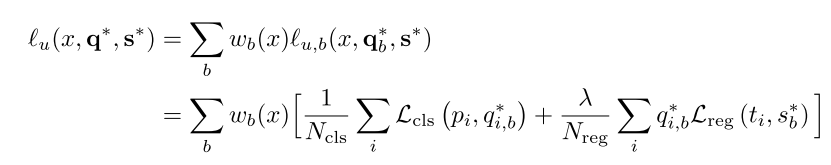

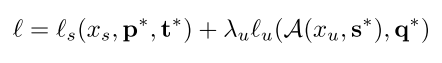

supervised loss function:

-

unsupervised loss function:

-

after join two function*:

-

其中A是应用与未标记图像的强数据增强。

-

-

数据增强

-

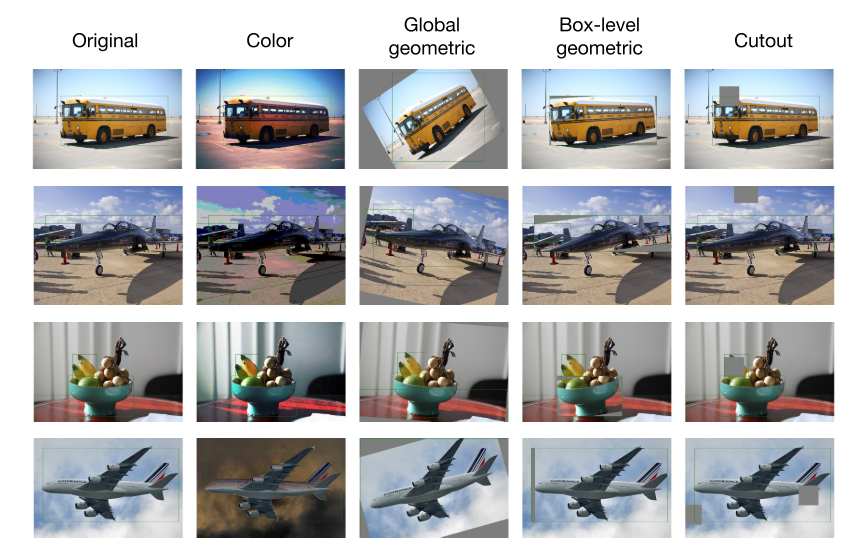

有以下三种增强方式:

- 全局色彩变换(C):使用[7]中的色彩变换操作和每个操作的建议幅度范围。

- 全局几何变换(G):使用[7]中的几何变换操作,即x-y平移,旋转和x-y剪切。

- 盒级变换[69](B):使用了来自全局几何变换的三个变换操作,但是幅度范围较小。

-

增强方法:

C -> G/B -> Random Cutout

-

Details

- 基于Faster RCNN和FPN

- 使用了ResNet-50

- λu 和 τ 的使用:

- λu:无监督损失的正则化系数

- τ:置信度阈值

- 当λu= 2且τ= 0.9时,STAC的性能最佳

虽然STAC使用伪标记可大大提高mAP的使用率,但我们的结果表明,伪标记质量的逐步提高可能不会带来显着的额外收益

不足

-

投入不足,需要更高级别的标签进行有效培训。

-

嘈杂的伪标签会过度使用!!

While STAC demonstrates an impressive performance gain already without taking confirmation bias [66,1] issue into ac- count, it could be problematic when using a detection framework with a stronger form of hard negative mining [47,29] because noisy pseudo labels can be overly- used. Further investigation in learning with noisy labels, confidence calibration, and uncertainty estimation in the context of object detection are few important topics to further enhance the performance of SSL object detection.

Reference

[1] K. Sohn, Z. Zhang, C.-L. Li, H. Zhang, C.-Y. Lee, and T. Pfister, “A Simple Semi-Supervised Learning Framework for Object Detection,” 2020, [Online]. Available: http://arxiv.org/abs/2005.04757.